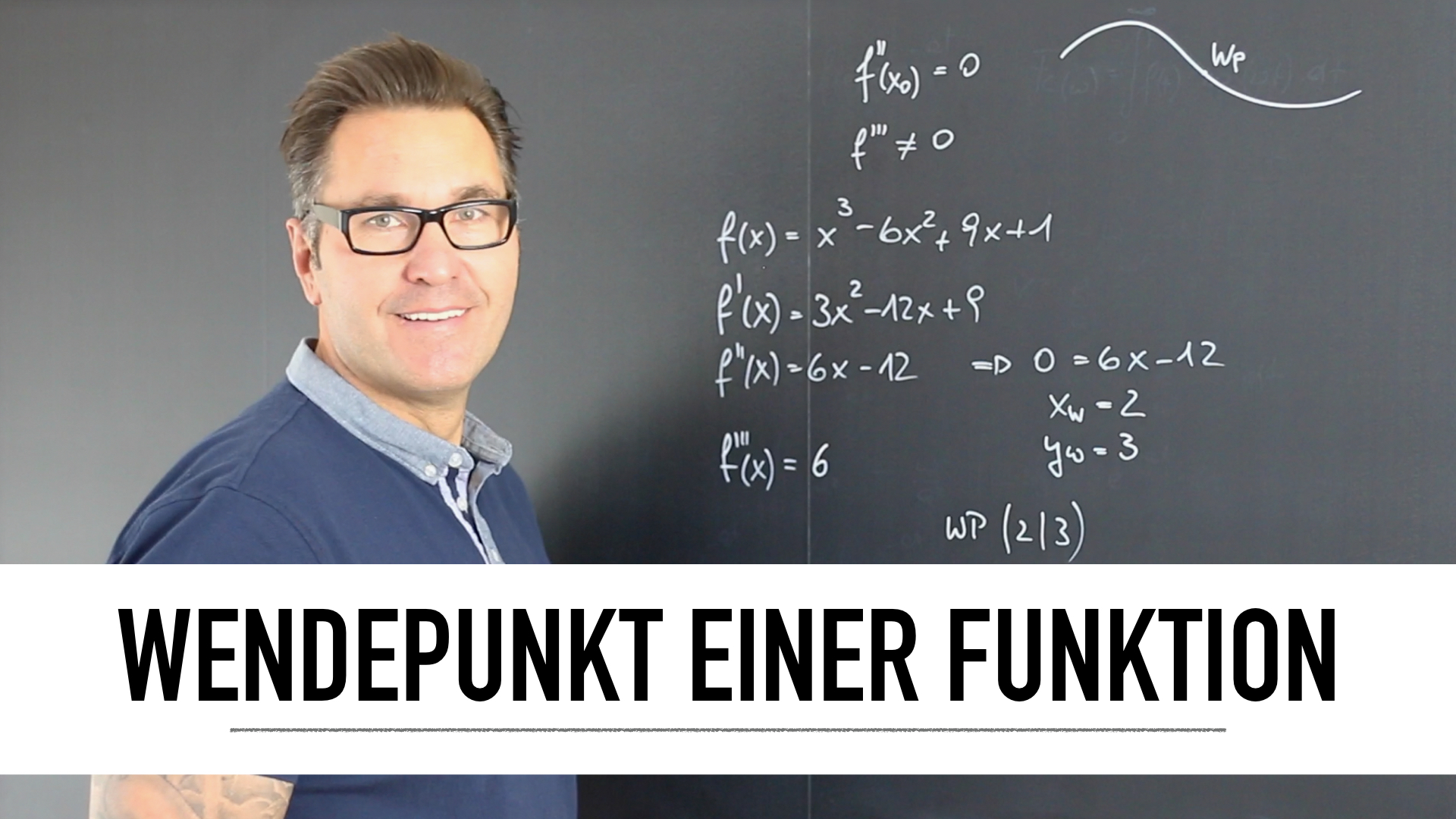

Wie berechne ich den Wendepunkt?

In der Mathematik ist ein Wendepunkt ein Punkt auf einem Funktionsgraphen, an dem der Graph sein Krümmungsverhalten ändert. Der Graph wechselt hier entweder von einer Rechts- in eine Linkskurve oder umgekehrt. Dieser Wechsel wird auch Bogenwechsel genannt. Die Ermittlung von Wendepunkten ist Bestandteil einer Kurvendiskussion.

Ein Wendepunkt W an der Wendestelle xW liegt vor, wenn die Krümmung des Funktionsgraphen an der Stelle xW ihr Vorzeichen wechselt. Daraus lassen sich verschiedene hinreichende Kriterien zur Bestimmung von Wendepunkten ableiten. Ein Kriterium fordert, dass die zweite Ableitung der differenzierbaren Funktion f an der Stelle xW ihr Vorzeichen wechselt.

Andere Kriterien fordern nur, dass die zweite Ableitung der Funktion Null ist und dass bestimmte höhere Ableitungen ungleich Null sind.

Betrachtet man die zweite Ableitung einer →Funktion f als „Steigung ihrer Steigung“, lassen sich ihre Wendestellen auch als [lokale] Extremstellen, das heißt [lokale] Maxima oder Minima, ihrer Steigung interpretieren.

Tangenten durch einen Wendepunkt heißen Wendetangenten. Wendepunkte, in denen diese Wendetangenten horizontal verlaufen, werden Sattel-, Terrassen- oder Horizontalwendepunkte genannt.

Notwendiges Kriterium für einen Wendepunkt

Sei f eine zweimal stetig differenzierbare Funktion, dann beschreibt, wie in der Definition schon angemerkt, die zweite Ableitung die Krümmung des →Funktionsgraphen. Da ein Wendepunkt ein Punkt ist, an dem sich das Vorzeichen der Krümmung ändert, muss die zweite Ableitung der Funktion f an diesem Punkt Null sein.

Ist xW eine Wendestelle, so ist f(xW) = 0

Als hinreichendes Kriterium ohne Verwendung der dritten Ableitung gilt folgendes.

Bei Kurvendiskussionen verwendest du in der Regel eine der beiden folgenden hinreichenden Bedingungen. In der ersten Bedingung kommt nur die zweite Ableitung vor; dafür muss das Vorzeichen von f″(xw) untersucht werden.

In der zweiten für einen Wendepunkt hinreichenden Bedingung wird auch die dritte Ableitung benötigt, allerdings nur an der Stelle xW selbst. Diese Bedingung wird vor allem dann verwendet, wenn die dritte Ableitung leicht zu ermitteln ist. Der Hauptnachteil gegenüber der schon erläuterten Bedingung liegt darin, dass du im Falle f‴(xw) = 0 keine Entscheidung treffen kannst.

→Funktionen 2. Ordnung, also quadratische Funktionen z.B. f(x)=x² können keine Wendepunkte haben, da sich die Krümmung des Graphen nicht ändert. Kubische Funktionen haben immer einen Wendepunkt.

In der Mathematik bezeichnet man als Sattelpunkt, Terrassenpunkt oder Horizontalwendepunkt einen kritischen Punkt einer Funktion, der kein Extrempunkt ist. Punkte dieser Art sind, wie die zuletzt genannte Bezeichnung es andeutet, Spezialfälle von Wendepunkten.